Еще недавно искусственный интеллект для компаний выглядел как приятный бонус: чат-бот на сайте, автоматическая обработка заявок, умные рекомендации, генерация текстов и быстрые ответы клиентам. Теперь вокруг этой темы меняется тон. В России обсуждают рамочное регулирование ИИ, а значит, компаниям уже стоит думать не только о пользе автоматизации, но и о том, как она устроена с точки зрения клиента, ответственности и правил работы. По состоянию на март 2026 года речь идет именно об обсуждаемом законопроекте и подходе к регулированию, а не о финальном вступившем в силу законе. Правительство и Минцифры публично говорили о «гибком» подходе и о продолжающейся подготовке предложений и законопроекта.

Главная ошибка здесь — думать, что тема касается только банков, медицины или государства. На практике вопрос намного ближе к обычному рынку. Если у вас на сайте стоит AI-чат, CRM автоматически сортирует лиды, бот отвечает клиентам, а алгоритм влияет на рекомендации, приоритет обращения или сценарий поддержки, вы уже находитесь в поле будущего регулирования. И чем сильнее система влияет на решение для клиента, тем выше риск, что именно этот участок придется объяснять, дорабатывать или страховать участием живого специалиста.

Кого это касается уже сегодня

В первую очередь — компаний, у которых умные системы уже встроены не в презентацию, а в реальные процессы. Чаще всего это:

- интернет-магазины с рекомендациями и автообработкой заявок;

- сервисные компании с ботами поддержки;

- клиники, образовательные платформы и онлайн-сервисы;

- CRM-системы, где алгоритмы влияют на маршрут заявки;

- сайты, где клиент проходит значительную часть пути без менеджера.

Пока многим кажется, что это просто вопрос удобства. На деле это уже вопрос того, как устроен сервис. Если пользователь не понимает, что с ним разговаривает алгоритм, не может быстро перейти к человеку или не получает понятного объяснения результата, проблема становится не технической, а деловой. В публичном обсуждении регулирования уже звучат темы прозрачности, ответственности, маркировки ИИ-контента и особого подхода к чувствительным сценариям.

Важное примечание: часть правил уже действует

Самый важный момент для компаний — часть рисков существует уже сейчас, даже без отдельного закона об искусственном интеллекте. В статье 16 закона № 152-ФЗ «О персональных данных» прямо сказано, что нельзя принимать решения, основанные исключительно на автоматизированной обработке персональных данных, если такие решения порождают юридические последствия для человека или иным образом затрагивают его права и законные интересы. Закон также требует разъяснить порядок такого решения и дать человеку возможность заявить возражение.

Проще говоря, автоматическое решение уже сегодня нельзя прятать в черный ящик и делать вид, что это просто «умная функция». Если алгоритм влияет на судьбу заявки, доступ к услуге, приоритет, цену или другой значимый результат, у компании уже есть поле ответственности. Поэтому вопрос не в том, будет ли регулирование, а в том, насколько болезненно ваш продукт его встретит.

Что именно обсуждают в регулировании ИИ в России

По публичным сообщениям, в России готовится рамочный законопроект об ИИ. Среди направлений, которые уже назывались, — базовые определения, права и обязанности участников, ответственность за ошибки ИИ, маркировка ИИ-контента, вопросы авторского права и правила применения технологии в отдельных сферах. При этом публичная позиция властей пока выглядит скорее как попытка не задавить рынок, а задать общую рамку и особенно внимательно смотреть на чувствительные сценарии.

Отдельно в публикациях 10 марта 2026 года сообщалось, что в одном из вариантов законопроекта обсуждается право клиента отказаться от обслуживания с использованием ИИ и получить услугу без него, а также обязанность уведомлять пользователя, если решения, затрагивающие его права и интересы, принимаются с помощью таких систем. Пока это не вступившая в силу норма, а обсуждаемый проект, но направление уже видно.

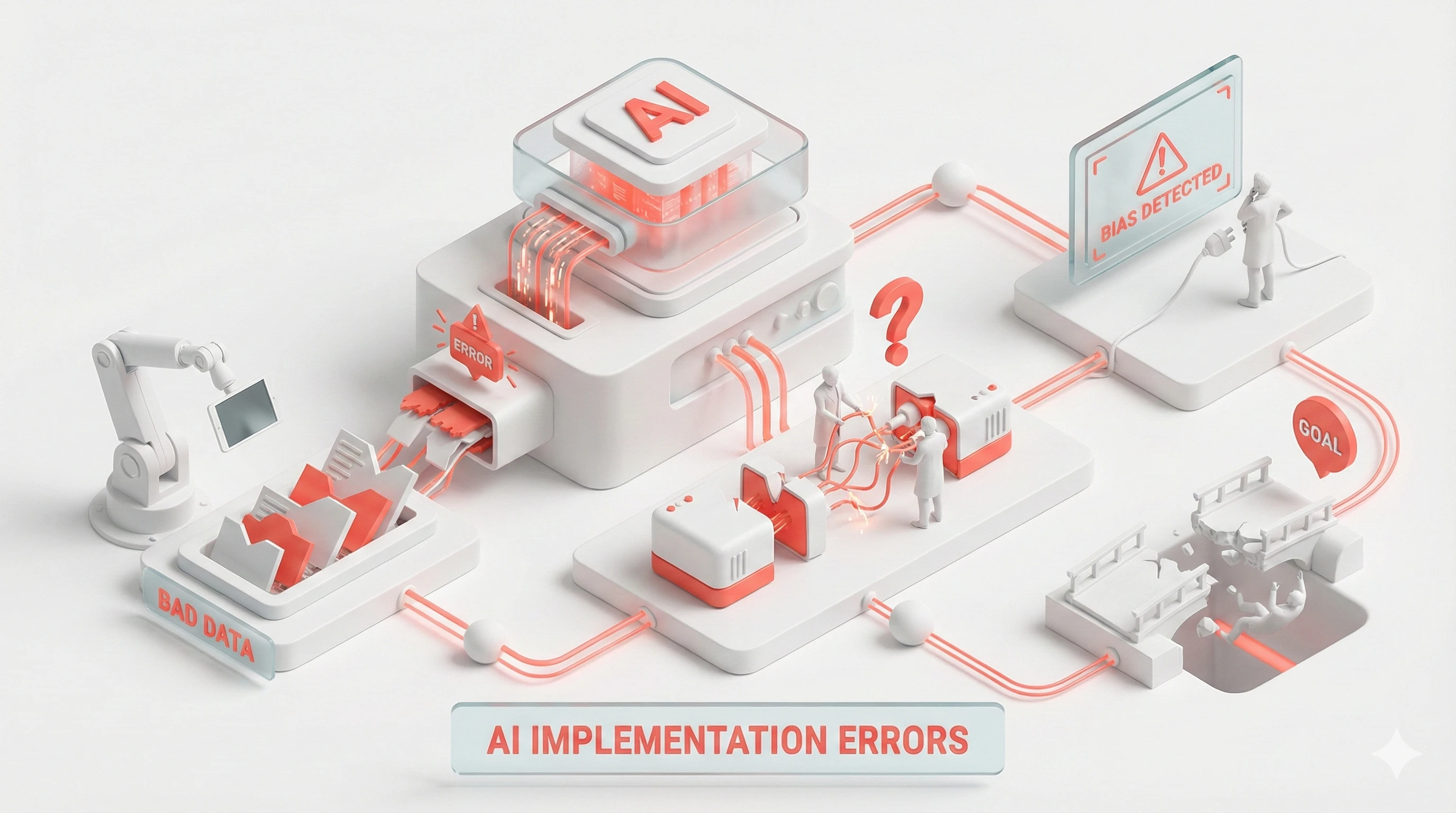

Где компании рискуют в первую очередь: четыре типовых сценария

Первый сценарий — бот, который не пускает к человеку. Пока вопрос простой, клиент терпит. Но как только речь заходит о деньгах, возврате, претензии, договоре или нестандартной ситуации, бег по кнопкам мгновенно ломает доверие. Если право на альтернативное обслуживание без ИИ закрепят, именно такие интерфейсы попадут под первую переделку.

Второй сценарий — автоматическая сортировка и оценка заявок. Например, CRM тихо присваивает обращению низкий приоритет, система режет лид как сомнительный, сервис отодвигает заявку в конец очереди или автоматически отказывает по внутренней логике. Снаружи это выглядит как обычная цифровая магия. Для клиента — как непрозрачное решение, которое влияет на его интересы. Такие случаи особенно чувствительны в логике статьи 16 закона о персональных данных.

Третий сценарий — ответы, рекомендации и контент без понятной маркировки. Пользователь читает текст, получает совет, взаимодействует с сервисом, но не понимает, где перед ним человек, а где модель. На фоне обсуждений о маркировке ИИ-контента это уже не мелочь интерфейса, а потенциальная зона конфликта между удобством, доверием и будущими требованиями.

Четвертый сценарий — чувствительные сферы. Чем ближе технология подходит к деньгам, здоровью, правам, доступу к услуге, безопасности или юридически значимому решению, тем осторожнее надо строить сценарий. Здесь история уже не про «давайте ускорим процесс», а про то, кто объяснит результат, если что-то пойдет не так.

Как подготовить сайт, CRM и AI-сценарии уже сейчас

Паниковать не нужно. Выключать автоматизацию и возвращаться в эпоху бесконечных таблиц, звонков и фразы «мы вам перезвоним» — тоже не лучшая идея. Нужна не капитуляция, а нормальная инженерная гигиена.

Для начала стоит честно выписать все точки, где технология соприкасается с клиентом. Не только очевидный чат-бот, но и:

- автоответы;

- рекомендации;

- маршрутизацию заявок;

- генерацию сообщений;

- фильтрацию лидов;

- голосовые сценарии;

- подсказки менеджерам;

- внутренний скоринг.

Обычно именно здесь компания неожиданно обнаруживает, что ИИ у нее уже не один, а целый оркестр. Дальше процессы нужно разделить на две группы. В первой технология помогает человеку: собирает данные, предлагает ответ, ускоряет работу, готовит черновик. Во второй она влияет на итог для клиента: дает отказ, меняет приоритет, ограничивает доступ, влияет на цену, срок или маршрут обслуживания. Вторая группа требует максимального внимания.

После этого полезно проверить три простых вопроса:

- понимает ли пользователь, что взаимодействует с ИИ;

- может ли он быстро перейти к живому специалисту;

- сохраняется ли история спорного решения.

Если хотя бы на один из этих вопросов ответ расплывчатый, зона доработки уже есть. И, наконец, важно убрать лишнюю самоуверенность из продукта. Технология хороша как помощник, ускоритель и фильтр. Но там, где нужны ответственность, объяснение результата и здравый смысл, человек должен оставаться реальной частью процесса, а не декоративной фигурой.

Чек-лист для компании на ближайшие 30 дней

На практике подготовка начинается не с презентации про инновации, а с обычного аудита.

- Соберите все клиентские сценарии, где участвует ИИ: сайт, поддержка, CRM, заявки, рекомендации, контент, рассылки, голосовые маршруты.

- Отметьте, где система просто помогает команде, а где реально влияет на решение для пользователя.

- Проверьте, может ли клиент быстро перейти к человеку без лишнего квеста.

- Посмотрите, поймет ли пользователь вообще, что перед ним не оператор, а алгоритм.

- Пересмотрите тексты интерфейса, FAQ, скрипты поддержки и правила обработки спорных случаев.

- Только после этого решайте, что менять в архитектуре: отключать спорные сценарии, добавлять ручную проверку или дорабатывать CRM-логику.

Это не выглядит героически, зато работает. В регулировании обычно выигрывает не тот, кто громче всех обещал полную автоматизацию, а тот, кто заранее оставил себе пространство для маневра.

Что это значит для внедрения ИИ без лишних рисков

Компании не нужен выбор между двумя крайностями: либо все отдать нейросети, либо вообще ничего не автоматизировать. Рабочая модель почти всегда гибридная. Алгоритмы ускоряют, сортируют, подсказывают, помогают команде и снимают рутину. Человек принимает спорные решения, объясняет результат, берет ответственность и удерживает доверие там, где автоматизация начинает хромать.

Именно такая логика дает продуктам нормальный запас прочности. Умный сайт, AI-ассистент, CRM или цифровой сервис должны быть не просто быстрыми, а понятными. Не просто современными, а управляемыми. Не просто автоматизированными, а устойчивыми к реальным вопросам клиента и будущим требованиям рынка.

Регулирование ИИ в России еще формируется, но направление уже видно. Компании все чаще придется отвечать не только на вопрос «где мы используем ИИ», но и на вопрос «как именно это влияет на клиента и кто отвечает, если система ошибется». Публично обсуждаются рамочные правила, прозрачность, маркировка и особый подход к чувствительным сферам, а действующее законодательство о персональных данных уже ограничивает полностью автоматические решения, затрагивающие права и интересы человека.

Выиграют не те, кто громче всех рассказывает про тотальную автоматизацию. Выиграют те, кто заранее разберет свои AI-сценарии, оставит человеку нужную роль в процессе и построит цифровой продукт без слепых зон. И это уже не теория про далекое будущее, а вполне практическая работа на ближайшие месяцы.